字节跳动发布Seed3D 1.0,仅需一张图即可生成高精度3D模型。

10月23日,字节跳动Seed团队正式发布其3D生成大模型——Seed3D1.0,该模型可实现从单张图像到高精度仿真级3D模型的端到端生成。

Seed3D1.0采用独特的DiffusionTransformer架构,经过大量数据训练,能够生成包含精细结构、真实材质以及基于物理渲染(PBR)的完整3D模型。

通过Seed3D1.0生成的3D模型可以顺利导入IsaacSim等仿真平台,仅需进行少量适配工作,即可支持具身智能大模型的训练。这一技术衔接为人工智能研究提供了更高效、便捷的路径,有助于加速虚拟环境与真实场景之间的数据交互与模型迭代。在当前AI技术快速发展的背景下,这种跨平台的兼容性显得尤为重要,能够有效降低开发门槛,提升整体研发效率。

此外,通过分步的场景生成方式,Seed3D1.0能够从单一物体开始,逐步扩展,构建出完整的3D场景。

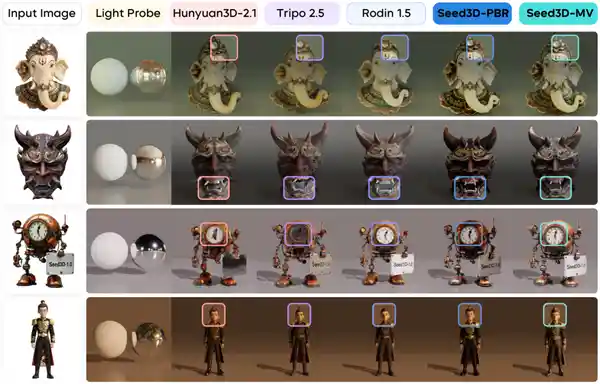

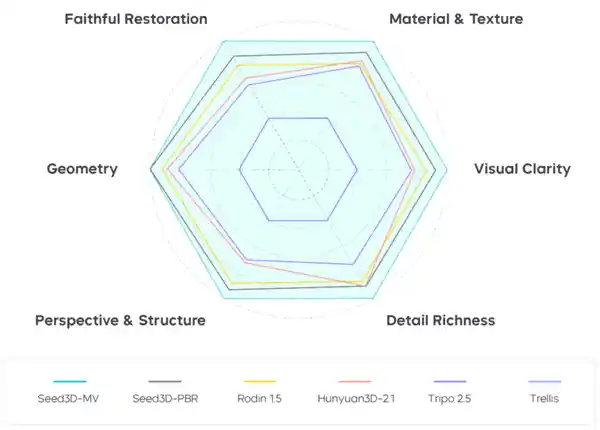

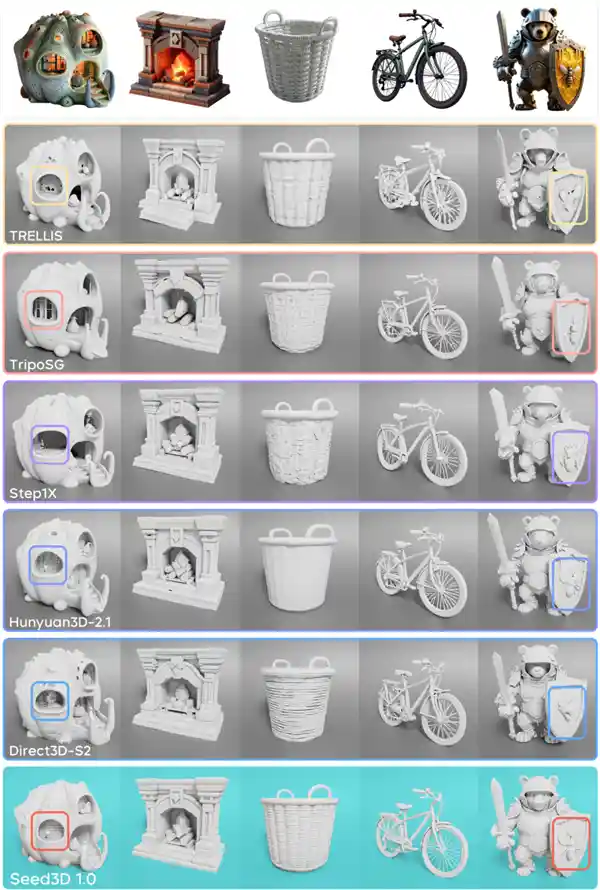

在与现有3D生成模型的对比中,Seed3D 1.0展现出优势:其纹理与材质生成性能超过此前的开源及闭源模型,几何生成性能超过业界更大参数规模的模型,综合能力达到行业领先水平。

目前Seed3D 1.0技术报告已公开,API也已上线,可访问项目主页查看:项目主页、体验入口

Seed3D1.0基于广泛应用于生成式AI的DiffusionTransformer模型架构,用于开发3D几何生成与纹理贴图的模型。

采用分步生成策略,Seed3D 1.0不仅能够生成单一物体,还能够扩展至构建完整且连贯的3D场景。

根据实测,Seed3D1.0在几何生成方面参数更少,但效果却更为出色;其在纹理材质生成方面的图像保持性表现也处于行业领先水平。这一技术进步不仅提升了生成效率,也为实际应用带来了更多可能性。从当前发展来看,这类技术的优化有助于推动3D内容创作的普及与深化。